本地虾风险还是有点大,各家也上线了各种云端虾。

Kimi出了K2.5,我第一时间开了Allegretto 套餐,199元/月的套餐,布局 KimiClaw 的最低配套餐,想试试Agent集群到底有多能打。MiniMax的Coding Plan也试了。

结果呢?Kimi隔三差五跳出“高峰时段算力不足”的提示,Agent任务跑到一半断掉是家常便饭。MiniMax那边更离谱,龙虾部署上去,聊两句就掉线,API动不动返回限速警告。

199块买了一张算力排队票。

翻了翻用户群,吐槽声不绝于耳,一个MiniMax用户@客服:“今天已经连续掉线了,聊2句就掉了。”客服回复:建议您检查本地网络。另一个人贴出终端截图,MiniMax API返回rate_limit_error,配图是一张“赛博牛马”的表情包:大哥,我就一个虾,隔了5分钟发了条消息,给我限速了。

小红书上也是,基本都是劝下车的。

简单来说就是,你花了钱,但算力不一定是你的。什么时候能用上,看运气,因为高峰时期限速太严重了。

那边的 Claude是动不动就限额,咱们这边是动不动就限速。还是能工智人好,run 一天只需要俩馒头。

不过算力紧缺这事儿早就不新鲜了,2月10日,Kimi因算力告急宕机,官方回应堪称行为艺术:“嗯,正在找算力。要不先用DeepSeek。”一家融了超20亿美元、手握100亿现金的公司,在自家产品最火的时候让用户去用竞品。DeepSeek自己也没好到哪去——2月28日、3月5日接连大规模宕机,服务器繁忙。

2026年春天,国产AI集体进入了“用不了”时代。

算力基建,提前兑现

直觉上,“算力荒”好像是禁令的锅。这个有道理,但不精确。

禁令是背景板,DeepSeek和Qwen这些模型本身就在资源约束下设计,MoE架构天然省算力。Kimi总裁张予彤之前在达沃斯说得很直白:仅用美国顶尖实验室1%的资源,做出了全球领先的开源模型。

真正击穿基础设施的,是Agent。

Chatbot是一问一答,算力消耗线性可预测。Agent完全不同——一个任务背后可能触发几十上百次模型调用:规划、拆解、执行、反思、纠错,每一步都过模型。长上下文持续占显存,工具调用让GPU空转。

Chatbot时代GPU就好像餐厅服务员,一桌客人上完菜就去下一桌。Agent时代,服务员全程陪同,从点菜到结账,思考菜单的时候也不能走。同样数量的服务员,能服务的桌数断崖式下降。

粗略计算的话,Chatbot单轮对话消耗约1,000到3,000个token。Agent做一个完整任务——比如用龙虾跑一次深度研究——要经历感知、规划、执行、反思等多个循环,中等复杂度轻松吃掉10万token,复杂任务到百万级。

有开发者报告单次OpenClaw运行烧掉了800万token。再叠加K2.5 Thinking这类推理链模型,思考过程本身的隐藏token能把成本再放大10到30倍。保守估计,从chatbot到Agent,单次任务算力消耗放大30到100倍,极端场景1,000倍以上。

Deloitte的研究点出了一个宏观悖论:过去两年token单价降了280倍,但企业AI账单反而飙升——推理成本降了1,000倍,需求增长了10,000倍。

问题是,Kimi和MiniMax自己并不拥有GPU。

从财报上看,MiniMax固定资产开支都极低,Kimi 虽然还没上市但情况也类似,算力几乎全部来自第三方云服务——轻资产模式,跟OpenAI自建数据中心完全不同。Kimi背后是火山引擎和阿里云双轨供应:火山引擎从2023年起独家提供训练和推理方案,后来阿里投了月之暗面8亿美元,其中一部分直接以阿里云算力结算,杨植麟公开给阿里云“代言”。MiniMax更复杂,阿里云、腾讯云、火山引擎都是它的供应商,早期招标会上三家杀到2折竞价。

谁也没想到,随着龙虾到来,token 需求的爆发来得如此之快。

Agent来了之后,价格战的逻辑跑不通了。“以后”变成了“现在”:未来缓慢补充基建的时间瞬间消失。

用户在骂Kimi卡的时候,Kimi可能也在骂火山引擎和阿里云卡。算力荒是从芯片到云服务到模型公司到用户的四层传导,Kimi和MiniMax站在最下游,承受每一层压力的叠加。

上游扛得住吗?

信号已经出现了。今年3月,国内云厂商开始集体调价——AI算力和存储产品价格上涨,涨幅从个位数到30%以上不等。优刻得直接开启全系涨价。海外也不例外,AWS和谷歌云在部分产品上试水调价。SK海力士公开表示2026年存储芯片持续涨价已成定局,DRAM库存仅剩约4周。持续二十年的“云服务只降不升”铁律,被AI需求击穿了。

涨价的逻辑不复杂。云厂商们过去一年疯狂扩建AI算力基础设施,资本开支动辄数百亿量级,但AI业务本身的利润率还很薄,远不够覆盖基建投入。Token调用量在指数级增长——2026年2月国内主流大模型日均消耗合计约180万亿——但卖Token的收入增速追不上建数据中心的花钱速度。涨价,不是云厂商贪心,是供应链涨价的无奈之举。

更棘手的是设备折旧。AWS、Google Cloud、Azure三家在2023-2024年统一把服务器折旧年限从3-4年延长到了6年,集体节省了约180亿美元的年度折旧开支。但NVIDIA的芯片迭代周期只有18-24个月——你今天花几千亿建的数据中心,里面的GPU可能两年后就不是最优选择了,折旧却要摊6年。

Satya Nadella自己都说:“我不想在一代芯片上背四五年的折旧。”

看一眼算力市场的格局。火山引擎凭借豆包以日均63万亿Token领跑,拿下公有云大模型调用量49.2%的份额,几乎一家占了半壁江山。阿里云日均32万亿排第二,腾讯元宝28万亿、DeepSeek 22万亿紧随其后。但调用量第一和营收第一不是同一家——按Omdia统计,阿里云以35.8%营收份额稳居AI云市场第一,超过第二到第四名总和。火山赢在“轻”,阿里赢在“重”。

Kimi和MiniMax的算力命脉就握在这两家手里。MiniMax上市后资本市场对Token增长狂热追捧——M2.5发布首周调用量暴涨至3.07万亿Token——但每一个Token背后都是真实的推理成本。MiniMax 2025年全年营收不足8000万美元,经调整净亏损2.5亿,毛利率刚爬到25%。上游一涨价,这个刚转正的毛利随时可能被吃掉。

这些问题反映到C端,只有一个结果:继续承受涨价或限流。Kimi配置最低的Allegretto套餐已经199元/月,几乎和包含Co-work以及Claude Code的Claude Pro同价了。如果继续涨价,我们所说的“白菜价”智能,就真的不存在了。

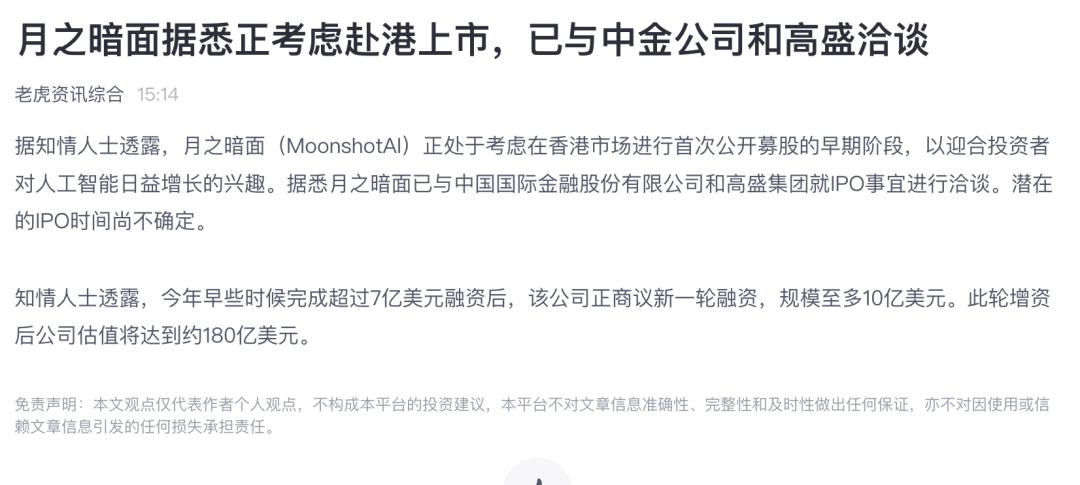

截至文章发布前,老虎证券刚刚发布消息,月之暗面已经开始考虑赴港上市。那Kimi就需要正面回答这个问题了:是继续租算力还是自己买设备,是保利润率还是保用户。MiniMax已经站在聚光灯下,每一季财报都是照妖镜。Kimi 本来手握 100 亿的账上资金,至少短期不用受到资本市场的审视,但刚好今天,就传出了 Kimi 赴港上市的传闻。

如果传闻是真的,那么 Kimi和 MiniMax 们真的需要考虑一个问题,到底是保用户还是保利润率。随着涨价链条的传递,大模型们被“两头堵”的可能性,已经骤然提升。

写在最后

2026年,Agent改变了算力的需求曲线。便宜的智能没变贵,使用智能的方式变了,资源出现了挤兑。

涨价什么时候会停?短期内恐怕看不到。Agent的需求曲线还在陡峭的上升期——Kimi K2.5刚上线不到一个月,收入就超过了2025年全年;MiniMax M2.5发布首周Token消耗量超过三家竞品之和。多Agent并行、长上下文推理、编程场景的爆发才刚刚开始,每一个新场景打开都意味着Token消耗量再上一个台阶。而供给侧的扩容周期是以年为单位的——数据中心从规划到投产至少18个月,芯片禁令下国产替代的产能爬坡更慢。需求按周增长,供给按年追赶,中间的剪刀差就是涨价和限流的空间。

更深层的变化是,中国的云厂商们可能正在被迫进入一个全新的重资产设备周期。过去二十年,云计算的叙事是“轻”——弹性伸缩、按需付费、用多少买多少。但Agent时代的算力需求把这个叙事翻了过来。阿里宣布三年投入3800亿建AI基础设施,字节在火山引擎上的算力部署同样激进。这些投入一旦启动就停不下来——你今天不建,明天的Token就没地方跑;但建了之后,折旧摊销会在未来五到十年持续压在利润表上。

这很像二十年前电信运营商铺3G/4G网络的周期:需求爆发倒逼巨额基建,基建倒逼涨价或补贴退坡,最终整个行业的利润结构被重塑。当年中国移动、中国联通经历的资本开支竞赛,今天可能在阿里云、火山引擎身上重演。区别在于,电信行业有牌照壁垒和政策保护,云厂商没有。

对于站在链条最下游的Kimi和MiniMax们来说,这意味着算力成本不会回到价格战时代的地板价了。对于用199元套餐跑龙虾的你和我来说,这意味着“便宜好用的AI”这个窗口期,可能比所有人想象的都要短。